Niedawno zaprezentowany model z rodziny DeepSeek-R1 wywołał niemałe poruszenie w społeczności związanej z rozwojem sztucznej inteligencji. Nowa technologia umożliwia uruchamianie zaawansowanych modeli rozumowania, które są zdolne do rozwiązywania problemów, operacji matematycznych oraz pisania kodu – wszystko to w pełnej prywatności, bez potrzeby łączenia się z chmurą, jedynie przy użyciu lokalnych komputerów.

Dzięki mocy obliczeniowej sięgającej 3 352 biliony operacji na sekundę, nowe karty graficzne z serii NVIDIA GeForce RTX 50 pozwalają na uruchamianie zadań opartych na DeepSeek w tempie, które dotąd pozostawało poza zasięgiem innych dostępnych na rynku komputerów osobistych. To duży krok naprzód w kierunku przeniesienia zaawansowanych obliczeń AI z dużych centrów danych na domowe PC.

Nowa generacja modeli rozumowania

Modele rozumowania, takie jak DeepSeek-R1, to kolejny etap rozwoju technologii dużych modeli językowych (LLM – Large Language Models). Kluczowym aspektem tych modeli jest ich zdolność do głębszego „zastanawiania się” i refleksji nad analizowanym zagadnieniem. Dzięki temu mogą one rozkładać złożone zadania na kroki i dostarczać użytkownikowi nie tylko rozwiązania, ale i proces, który doprowadził do konkretnego wyniku.

Podstawowe założenie tej technologii opiera się na idei, że każde wyzwanie można rozwiązać dzięki dogłębnemu myśleniu oraz poświęceniu odpowiedniej ilości czasu. Modele takie jak DeepSeek-R1 wykorzystują test-time scaling, czyli dynamiczny przydział zasobów obliczeniowych podczas rozumowania nad zadaniami. W praktyce oznacza to, że modele są w stanie dostarczać precyzyjniejsze wyniki, zużywając przy tym mniej zasobów niż konwencjonalne rozwiązania.

Zastosowanie takich modeli na komputerach osobistych otwiera drzwi do zupełnie nowych doświadczeń użytkownika. Modele mogą lepiej zrozumieć potrzeby użytkownika, realizować zautomatyzowane działania oraz oferować możliwość przeglądu i poprawy procesu wnioskowania. Dzięki temu użytkownicy mogą rozwiązywać złożone, wieloetapowe zadania, takie jak analiza rynkowa, zaawansowane obliczenia matematyczne, debugowanie kodu czy przygotowywanie niestandardowych analiz danych.

Unikalność modeli DeepSeek

Rodzina modeli DeepSeek-R1 wyróżnia się zastosowaniem struktury mieszanki ekspertów (Mixture-of-Experts, MoE). Model o 671 miliardach parametrów składa się z szeregu mniejszych, wyspecjalizowanych modeli, które współpracują ze sobą nad rozwiązaniem problemów. Proces ten pozwala na efektywne podzielenie pracy, co zwiększa wydajność oraz dokładność wyników.

Aby uczynić technologię bardziej przystępną, DeepSeek zastosował technikę destylacji. Dzięki temu powstała rodzina sześciu mniejszych modeli – od 1,5 do 70 miliardów parametrów – które można uruchomić na komputerach z kartami RTX z zachowaniem wysokiej wydajności. Te „uczniowskie” modele opanowały zdolności wnioskowania znacznie większego modelu, zachowując jednak kompaktową strukturę i wybitną szybkość działania. To idealne rozwiązanie dla osób, które potrzebują lokalnego, szybkiego i zaawansowanego systemu sztucznej inteligencji.

Najlepsza wydajność dzięki kartom RTX

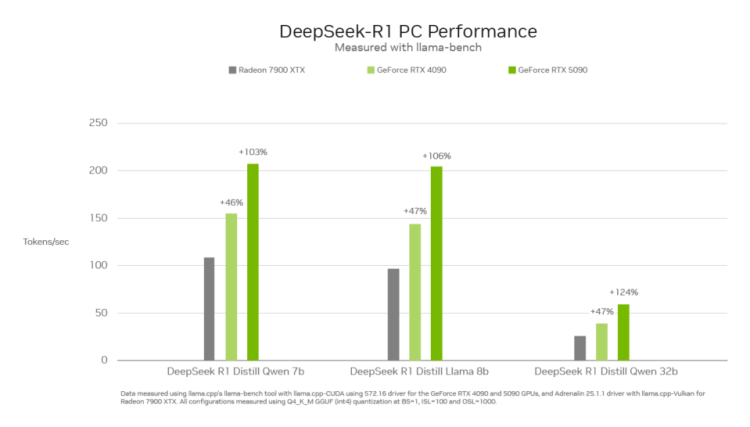

Szybkość wnioskowania to kluczowy czynnik w nowoczesnych modelach AI. Karty graficzne NVIDIA GeForce RTX 50, wyposażone w dedykowane piątej generacji rdzenie Tensor, bazują na architekturze NVIDIA Blackwell. To technologia, która napędza rozwój sztucznej inteligencji w centrach danych i teraz zyskuje dostępność na komputerach osobistych.

Karty RTX w pełni wykorzystują potencjał DeepSeek, dostarczając maksymalnych możliwości inferencji z zachowaniem minimalnego czasu reakcji. Dzięki temu użytkownicy komputerów PC mogą korzystać z zaawansowanej technologii AI bez skomplikowanych konfiguracji sprzętowych czy konieczności przesyłania danych wrażliwych do chmury.

Nowe funkcjonalności dostępne w popularnych narzędziach

Platforma NVIDIA RTX AI oferuje kompleksowy zestaw narzędzi, pakietów SDK i modeli, umożliwiając użytkownikom łatwy dostęp do technologii DeepSeek-R1 na ponad 100 milionach komputerów osobistych z kartami RTX. W tej liczbie znajdują się również te wyposażone w najnowsze karty graficzne serii RTX 50.

Co ważne, wysokowydajne GPU RTX pozwalają na wykorzystanie wszystkich możliwości modeli AI bez konieczności połączenia z internetem. Dzięki temu użytkownicy zyskują nie tylko większą prywatność, ale również minimalizują opóźnienia, co jest szczególnie istotne w zadaniach wymagających szybkiej reakcji oraz zachowania danych wrażliwych lokalnie.

DeepSeek-R1 współpracuje z szerokim ekosystemem oprogramowania, w tym z takimi rozwiązaniami jak <a href="https://github.com/ggerganov/llama.cpp" target="blank”>Llama.cpp, <a href="https://ollama.com/library/deepseek-r1" target="blank”>Ollama, <a href="https://lmstudio.ai/blog/deepseek-r1" target="blank”>LM Studio czy <a href="https://docs.anythingllm.com/changelog/v1.6.8#whats-new" target="blank”>AnythingLLM. Dodatkowo, narzędzie Unsloth umożliwia precyzyjne dostosowanie modeli do konkretnych potrzeb użytkownika, co jeszcze bardziej zwiększa ich uniwersalność i funkcjonalność.