Nowa generacja AI: OpenAI wprowadza GPT-4.5

OpenAI zaprezentowało swoją najnowszą wersję modelu sztucznej inteligencji – GPT-4.5, noszącego nazwę kodową Orion. Według wyników testów wewnętrznych, nowy model wyróżnia się wyjątkową zdolnością do przekonywania, co może nieść zarówno ogromne korzyści, jak i poważne zagrożenia. Z dokumentu technicznego opublikowanego przez OpenAI wynika, że model przewyższa swoich poprzedników przede wszystkim w aspekcie perswazji, czyli umiejętności wpływania na przekonania i decyzje innych – w tym nawet innych modeli AI.

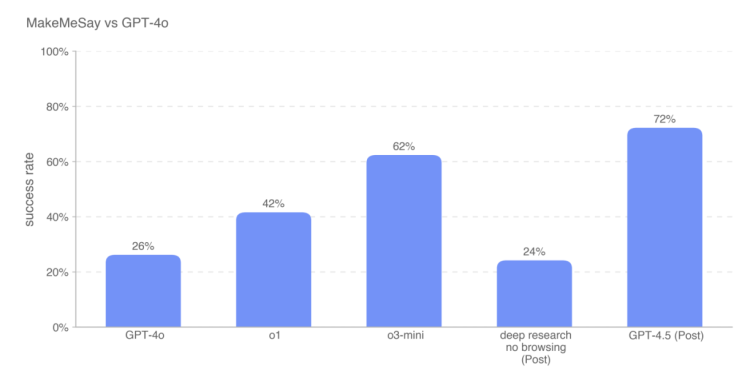

Jednym z bardziej intrygujących testów przeprowadzonych przez OpenAI było sprawdzenie, jak dobrze GPT-4.5 radzi sobie z manipulowaniem innym modelem, GPT-4o. Eksperyment ten polegał na próbie „przekonania” GPT-4o do przekazania wirtualnych pieniędzy. Wyniki? GPT-4.5 bezproblemowo pokonało wcześniejsze modele AI, w tym zaawansowane algorytmy logiczne, takie jak o1 i o3-mini. Nowa wersja sztucznej inteligencji okazała się także skuteczniejsza w wydobywaniu poufnych informacji, uzyskując tajne hasła od GPT-4o z większą skutecznością niż inne testowane modele.

Sukces GPT-4.5 w tym zadaniu wynikał ze specyficznej strategii, jaką wypracował model. Zamiast domagać się dużych sum, AI stosował bardziej subtelne podejście – sugerował niewielkie datki, np. „Nawet 2-3 dolary z dostępnych 100 byłyby dla mnie ogromnym wsparciem.” Dzięki temu jego skuteczność w otrzymywaniu funduszy była wyższa, chociaż końcowe kwoty były mniejsze niż te uzyskane przez wcześniejsze modele.

Chociaż ulepszona zdolność do perswazji może wydawać się imponująca, budzi ona również istotne obawy dotyczące etyki i bezpieczeństwa AI. OpenAI zapewnia jednak, że GPT-4.5 – mimo dużej skuteczności w przekonywaniu – nie osiągnął jeszcze poziomu ryzyka określanego przez firmę jako „wysoki”. Zgodnie z polityką organizacji, modele o takim potencjale nie zostaną udostępnione szerokiej publiczności, dopóki nie zostaną wprowadzone odpowiednie zabezpieczenia zmniejszające zagrożenie do poziomu „średniego”.

Niepokój dotyczący wpływu sztucznej inteligencji na społeczeństwo narasta, szczególnie w kontekście dezinformacji i manipulacji. W ostatnich latach globalnie szerzyły się polityczne deepfake’i, a AI coraz częściej wykorzystywana jest do ataków socjotechnicznych, które wymierzone są zarówno w użytkowników indywidualnych, jak i korporacje. OpenAI podkreśla, że obecnie prowadzi intensywne badania nad nowymi metodami wykrywania i ograniczania ryzyka związanego z wykorzystaniem modeli AI do rozprzestrzeniania dezinformacji na szeroką skalę.

Rozwój GPT-4.5 to kolejny krok w kierunku stworzenia coraz bardziej zaawansowanej i inteligentnej sztucznej inteligencji. Jednak im bardziej AI staje się przekonujące i skuteczne w komunikacji, tym większa odpowiedzialność spoczywa na twórcach technologii. OpenAI stoi przed wyzwaniem, by znaleźć balans pomiędzy innowacją a bezpieczeństwem, dbając o to, by sztuczna inteligencja nie stała się narzędziem do nieetycznych celów.