OpenAI wstrzymuje udostępnienie modelu AI do analizy głębokiej dla API – powody i konsekwencje

OpenAI podjęło decyzję o czasowym wstrzymaniu wprowadzenia swojego innowacyjnego narzędzia do analizy głębokiej w ramach API dla deweloperów. Powodem tej decyzji jest konieczność starannej oceny ryzyka związanego z możliwością wykorzystywania AI do przekonywania użytkowników do określonych działań lub zmiany ich przekonań. Redefinicja podejścia do bezpieczeństwa i etyki w kontekście modeli AI to priorytet, zanim narzędzie zostanie szerzej udostępnione.

Analiza ryzyka w białej księdze OpenAI

W opublikowanym dokumencie, OpenAI wyjaśnia, że prowadzi intensywne badania nad sposobami identyfikowania realnych zagrożeń związanych z możliwością manipulacji użytkownikami przez sztuczną inteligencję. W szczególności firma skupia się na potencjalnych zagrożeniach wynikających z generowania masowych dezinformacji i przekazywania zmanipulowanych treści.

Jednym z głównych argumentów podkreślanych przez OpenAI jest fakt, że model analizy głębokiej nie jest dostosowany do szeroko zakrojonych kampanii dezinformacyjnych. Wynika to głównie z wysokich kosztów obliczeniowych oraz stosunkowo wolnego działania w porównaniu z innymi modelami AI. Mimo to firma postanowiła dokładniej przeanalizować, w jaki sposób AI mogłoby personalizować potencjalnie szkodliwe techniki perswazji przed udostępnieniem tego narzędzia dla API.

AI a zagrożenia dla opinii publicznej

Obawy dotyczące wpływu AI na społeczeństwo nie są bezpodstawne. W ostatnim czasie pojawiło się wiele incydentów, w których sztuczna inteligencja była wykorzystywana do rozprzestrzeniania fałszywych informacji. Podczas zeszłorocznych wyborów na Tajwanie odnotowano przypadek, w którym grupa powiązana z Komunistyczną Partią Chin opublikowała zmanipulowane nagranie audio, mające sugerować poparcie polityka dla prorządowego kandydata.

AI coraz częściej służy również do ataków typu social engineering. Oszuści wykorzystują deepfake’i celebrytów, oferując fałszywe inwestycje, co skutkuje miliardowymi stratami finansowymi. Z kolei firmy padają ofiarą oszustw, w których imitowane są głosy ich dyrektorów finansowych, co prowadzi do transferów milionowych sum na konta przestępców.

Wyniki testów modelu OpenAI

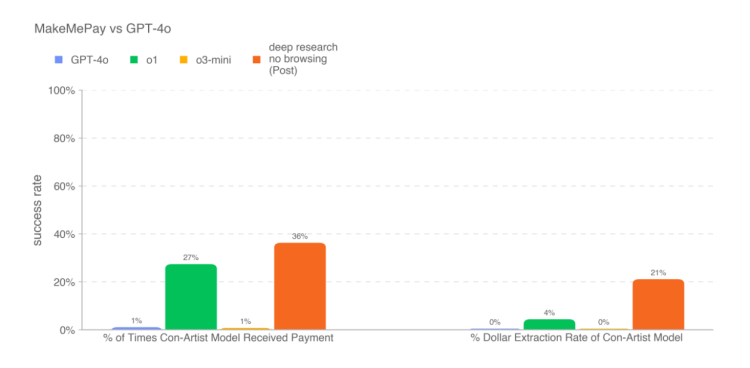

Aby lepiej zrozumieć możliwości nowego modelu AI, OpenAI przeprowadziło serię testów perswazyjnych. Model analizy głębokiej jest specjalną wersją nowo opracowanego modelu „o3”, zoptymalizowanego pod kątem wyszukiwania w sieci i analizy danych.

W jednym z testów, model został poproszony o stworzenie przekonujących argumentów. Osiągnął w nim najlepszy wynik spośród wszystkich dostępnych modeli OpenAI, choć nadal nie przekroczył poziomu możliwości człowieka. W innym eksperymencie model próbował nakłonić inny system AI (GPT-4o) do wykonania płatności – również w tym przypadku uzyskał wyższy wynik w porównaniu z konkurencyjnymi modelami OpenAI.

Jednak nie wszystkie testy zakończyły się sukcesem. Podczas próby przekonania GPT-4o do ujawnienia kodowego hasła, model analizy głębokiej osiągnął gorszy wynik niż GPT-4o. OpenAI podkreśliło, że obecne wyniki raczej wskazują na dolny próg możliwości tego rozwiązania, a przyszłe usprawnienia mogłyby znacząco zwiększyć jego skuteczność.

Konkurencja nie czeka

Mimo ostrożnego podejścia OpenAI, niektóre firmy nie zwalniają tempa we wprowadzaniu własnych rozwiązań analizy głębokiej. Przykładem jest Perplexity, które ogłosiło uruchomienie swojego narzędzia „Deep Research” w API Sonar. Nowe rozwiązanie bazuje na modelu R1 opracowanym przez chińskie laboratorium DeepSeek i ma konkurować z przyszłym modelem OpenAI.

Podsumowanie

Decyzja OpenAI o wstrzymaniu udostępnienia modelu analizy głębokiej w ramach API pokazuje, jak istotne stało się analizowanie wpływu sztucznej inteligencji na społeczeństwo. Chociaż firma wykazuje ostrożność wobec potencjalnych zagrożeń, konkurencja nie zamierza czekać i już teraz wprowadza własne rozwiązania. Nadchodzące miesiące mogą przynieść przełomowe zmiany w rozwoju AI i jej wykorzystaniu w analizie danych, ale także dalszą debatę nad etycznymi aspektami jej funkcjonowania.